引言:60MB源码引发的行业地震

近日,AI领域发生了一起备受瞩目的事件:Anthropic公司在发布其官方开发工具Claude Code的更新时,因一次配置失误,在npm仓库的v2.1.88版本中意外打包了约60MB的Source Map调试文件。这一疏忽如同打开了潘多拉魔盒,安全研究人员通过逆向工程,成功还原了1906个原始TypeScript源码文件,使得这款AI编程工具的内部架构、交互协议、安全机制乃至核心的提示词策略悉数暴露在公众视野之下。作为潮·科技栏目的观察者,本文将深入解读此次Claude Code源码泄露事件,剖析其背后的技术细节、对Anthropic技术壁垒的影响,以及更为重要的——对广大开发者与企业用户的现实安全警示。

泄密细节深度解读:从“配置失误”到“核心机密”暴露

此次泄露并非黑客攻击,而是一次典型的“低级错误”引发的信息安全事故。虽然Anthropic并未泄露其核心的Claude大模型权重,但泄露的源码内容之丰富,足以让竞争对手和行业观察者一窥其工程化能力的天花板。

1. 核心提示词(System Prompt)策略曝光

在AI开发工具中,System Prompt(系统提示词)是定义AI行为逻辑、角色定位和输出规范的“灵魂”。泄露的源码中完整展示了Claude Code是如何通过复杂、精细的提示词工程,来引导模型准确理解用户意图、规划代码修改步骤、以及遵循特定的输出格式。这相当于将Anthropic在AI交互体验优化上的“独门秘籍”公之于众。

2. 安全沙箱与权限控制逻辑

对于AI编程工具而言,如何在赋予模型强大能力(如读写文件、执行命令)的同时,确保其不会“失控”并对系统造成破坏,是衡量其安全性的关键。泄露的源码清晰地揭示了Claude Code的安全沙箱实现机制和权限控制逻辑。例如,代码中可能详细定义了哪些文件路径被允许访问、在执行高风险命令前如何请求用户二次确认等。这些工程细节的暴露,虽然短期内为恶意行为者提供了分析目标,但从长远看,也引发了行业对AI工具安全设计透明度的思考。

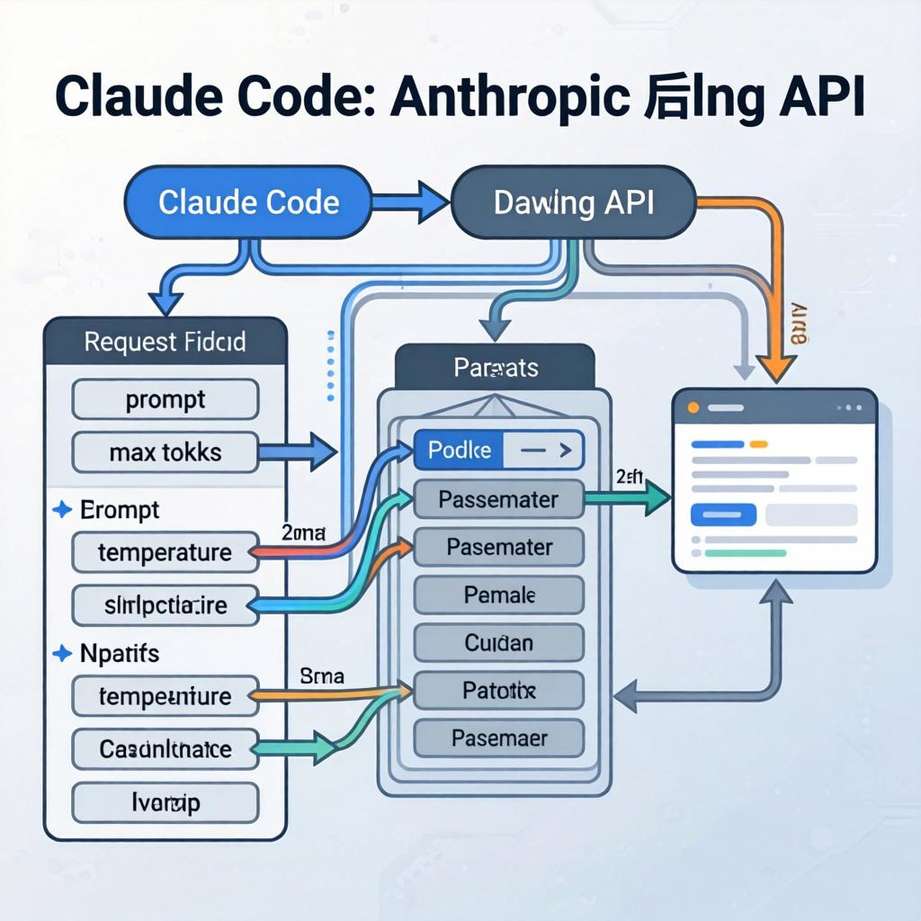

3. 后端API交互与遥测逻辑

此外,泄露的源码还暴露了Claude Code与Anthropic后端API的交互协议,包括请求的数据结构、认证方式以及内部遥测数据采集逻辑。遥测数据通常用于分析工具的使用情况和性能瓶颈,但这类数据的采集方式和范围一直是开发者关注的隐私焦点。此次事件让公众清晰地看到了Anthropic在用户行为数据收集上的具体策略。

对Anthropic的技术壁垒:打击与启示并存

那么,这次泄露对Anthropic的技术壁垒究竟造成了多大打击?从短期来看,无疑是一次重创。

- 核心方法论外流:精心设计的提示词策略和安全机制是经过大量试错积累的经验,竞争对手可以在此基础上快速学习甚至“微创新”,缩短其在类似工具研发上的“试错周期”。

- 安全风险敞口扩大:源码公开意味着其内部系统的薄弱环节可能被更快速地发现和利用。虽然目前未发现可直接利用的漏洞,但这种透明度无疑增加了未来被攻击的风险。

然而,从长期来看,这也可能成为推动行业进步的一个契机。正如开源软件通过公开代码实现更快的迭代和安全加固一样,此次事件或将迫使Anthropic以及整个行业重新审视开发工具的安全发布流程和隐私保护设计,从而催生更健壮、更透明的下一代AI开发工具。

行业视角:从“工具安全”到“生态信任”的拷问

此事件的影响远不止于Anthropic一家公司。它如同一面镜子,折射出当前整个AI开发工具生态中存在的隐忧,特别是对于正在使用这类工具的企业和开发者而言。

1. 潜在的安全漏洞风险

虽然尚未有明确证据表明泄露的源码中存在可直接利用的漏洞,但源码的完全公开,为攻击者提供了绝佳的“代码审计”机会。攻击者可以深入分析其代码执行逻辑、权限控制缺陷,并尝试构造恶意利用。对于依赖Claude Code进行开发的企业来说,在官方发布安全补丁或修复版本前,其开发环境面临的风险是真实存在的。

2. 隐私泄露的深层担忧

泄露的源码中包含了详细的内部遥测数据采集逻辑,这直接触动了开发者最敏感的神经。遥测数据究竟采集了什么?是否涉及代码内容?这些数据的存储和使用是否符合GDPR等隐私法规?此次事件让开发者在选择AI工具时,不得不更审慎地考虑工具的数据隐私政策和透明度。正如一位安全研究员在社交平台X上指出,这类基础工程失误所带来的信任成本是巨大的。

“我们(开发者)正在将我们的代码、我们的思考过程,以及我们开发环境的控制权部分交给AI。当这些AI工具的内部机制变得不再安全时,我们的整个开发流水线都可能暴露在风险之下。”

开发者避坑指南:如何选择更安全的AI编程伙伴

作为“搓一淘好物推荐”的潮·科技栏目,我们的宗旨是为大家提供有价值的科技产品洞察与选择建议。面对此次事件,开发者们应当如何调整自己的工具选择策略?以下是几点“避坑”参考:

| 考量维度 | 安全优先的选择建议 |

|---|---|

| 安全发布流程 | 选择有严格CI/CD流程和代码审查机制的大厂工具,警惕那些发布历史混乱、版本更新说明模糊的工具。 |

| 数据隐私政策 | 优先选择对数据采集、存储和使用有明确说明,并提供用户控制选项的工具。对于闭源但宣称“本地运行”的工具,需进一步核实其网络活动。 |

| 权限与沙箱机制 | 优先选择提供精细化权限控制、明确沙箱隔离环境的工具。了解工具在请求执行敏感操作(如修改系统文件)时的交互方式,越透明越好。 |

| 开源与透明度 | 虽然此次事件由闭源工具的意外泄露引发,但开源工具在安全性上具有“阳光是最好的杀毒剂”的优势,社区可以更快地发现并修复问题。选择开源或开放核心代码的工具,是降低风险的长远之策。 |

总结:安全是AI开发工具的生命线

综上所述,Anthropic Claude Code的源码泄露事件绝不仅仅是一次简单的配置失误。它以一种极端的方式提醒了整个科技行业:当AI开发工具成为开发者“新手臂”时,工具本身的安全性、透明度和隐私保护水平,已经上升到决定其商业价值和用户信任的“生命线”高度。对于开发者而言,这无疑是一堂昂贵的“风险教育课”。在拥抱AI带来的效率红利时,我们更应擦亮双眼,将安全与隐私作为选择AI工具的首要考量标准。只有建立在信任之上的技术,才能真正为我们的创造保驾护航。

此次事件后续将如何发展,Anthropic又将如何应对并修复信任,我们将持续保持关注,为潮·科技的读者带来最新、最深度的行业观察。请记住,在技术的浪潮中,保持理性与审慎,永远是“搓一淘好物推荐”不变的初衷。

未经允许不得转载:搓一淘趣闻 » Claude Code源码泄露解读:AI开发工具安全警示与行业影响

北京范儿短视频大赛圆满收官:京味文化传承

北京范儿短视频大赛圆满收官:京味文化传承 全民共创短视频活动深度解析|京彩中国年创

全民共创短视频活动深度解析|京彩中国年创 智能语音控制空气炸锅深度体验:核心功能与

智能语音控制空气炸锅深度体验:核心功能与 中国科学家成功制备二维金属材料,实现材料

中国科学家成功制备二维金属材料,实现材料 AI驱动智能制造跨越式发展,从规模红利迈

AI驱动智能制造跨越式发展,从规模红利迈 智能家居选购攻略与未来打造指南,揭秘选购

智能家居选购攻略与未来打造指南,揭秘选购 未来热销产品盘点:智能化惊喜改变生活

未来热销产品盘点:智能化惊喜改变生活 咸味苏打饼干让人上瘾的简单秘密,竟藏在这

咸味苏打饼干让人上瘾的简单秘密,竟藏在这