引言:AI编程工具热潮下的新变量

近年来,AI编程工具已成为开发者提升效率的“秘密武器”。从GitHub Copilot到各类开源模型,选择越来越多。就在最近,Google 发布的开源大模型 Gemma4系列正式亮相,迅速在技术圈引发热议。作为“搓一淘好物推荐”旗下关注前沿科技趋势的潮·科技栏目,我们更关心的是:这款模型对于普通开发者和技术爱好者来说,到底意味着什么?它能否成为AI编程领域的首选工具?本文将从产品趋势与用户选择的角度,为你带来一份基于真实信息的解读。

在AI编程工具遍地开花的今天,Google 发布的开源大模型 Gemma4并非凭空出现。它继承了Gemma系列轻量、高效的基因,同时针对代码理解与生成能力进行了强化。据公开信息,该模型提供了2B、7B、27B等多种参数版本,可适配从移动端到云端的不同场景。这背后,是Google在开源生态与商业应用之间的一次重要平衡。

一、Gemma 4的核心能力:不止于代码补全

要判断一个模型能否成为AI编程的首选,首先要看它的核心能力。根据Google官方及第三方早期评测,Gemma 4在HumanEval等代码生成基准测试中表现优异,部分版本得分接近甚至超过同尺寸的Llama和DeepSeek模型。但更值得关注的是其设计理念:Gemma4并非单纯追求参数规模,而是强调“开箱即用”的实用性。

- 多语言覆盖:原生支持Python、Java、JavaScript、C++等主流编程语言,对Rust、Go等新兴语言也有较好适配。

- 长上下文窗口:最大支持8K-128K tokens(不同版本有差异),可一次性处理整个中等规模项目文件。

- 本地部署友好:经过量化优化后,2B版本甚至可以在旗舰手机上运行,7B版本可在消费级GPU(如RTX 3060)上流畅推理。

然而,能力强大并不等于体验优秀。我们注意到,早期用户反馈中,Gemma 4在处理复杂算法逻辑或罕见框架时,偶尔会出现“幻觉”(生成不存在的API)。这一点与闭源的GPT-4或Claude 3.5相比仍有差距,但在开源模型中已属第一梯队。

对比开源竞品:参数与场景的取舍

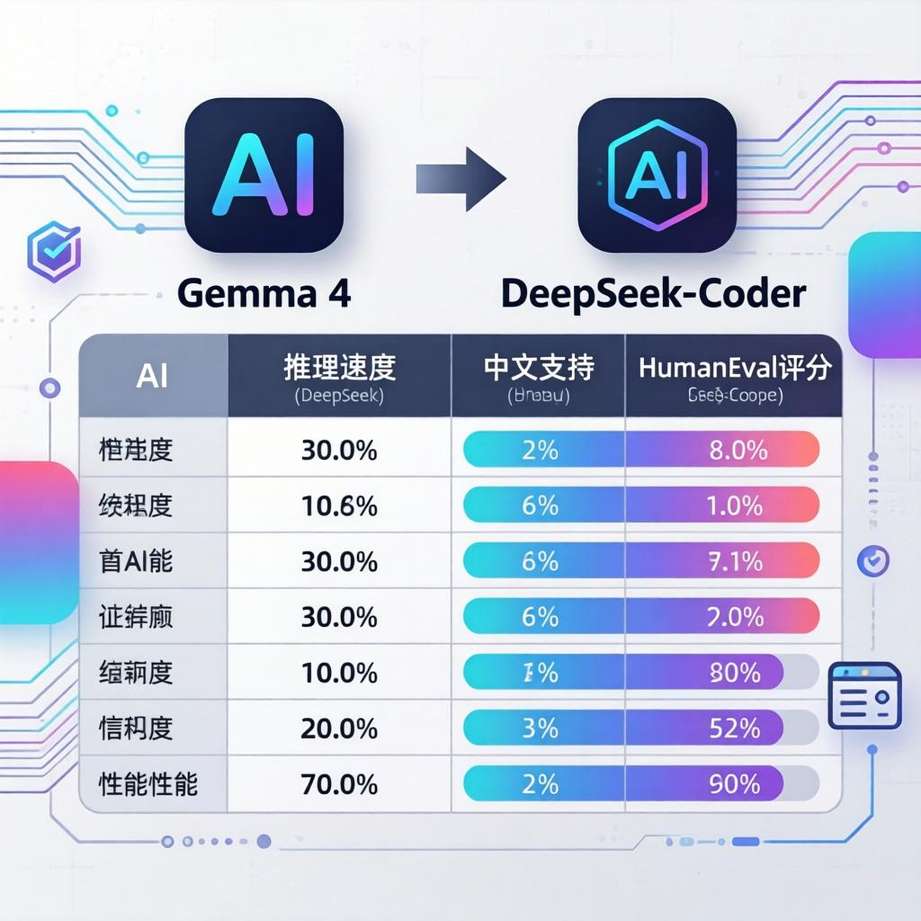

为了更直观地理解Google 发布的开源大模型 Gemma4在AI编程领域的定位,我们将其与两款热门开源模型进行横向对比:Meta的Code Llama和DeepSeek-Coder。下表基于公开的模型卡片和社区测试数据整理,反映了产品趋势中的不同侧重。

| 对比维度 | Gemma 4 (7B) | Code Llama (7B) | DeepSeek-Coder (6.7B) |

|---|---|---|---|

| 许可协议 | Gemma条款(允许商用) | Llama 3 社区许可 | MIT |

| HumanEval得分 | 约68% | 约62% | 约70% |

| 中文代码注释 | 原生支持较好 | 一般 | 优秀 |

| 推理速度 (tokens/s) | 约85 | 约72 | 约78 |

从表格可见,Gemma 4在推理速度和中文支持上有一定优势,但HumanEval得分略低于DeepSeek-Coder。因此,是否成为首选,取决于你的具体场景:追求快速本地迭代和英文注释质量,Gemma 4很合适;若主要处理中文代码库或需要MIT协议,DeepSeek-Coder可能更优。

二、用户选择的三重门槛:成本、生态与习惯

技术参数之外,AI编程工具的实际首选地位往往由非技术因素决定。我们观察到三个关键门槛:部署成本、生态集成和使用习惯。

- 成本门槛:虽然模型开源免费,但自部署需要GPU资源。云端API调用方面,Google Cloud Vertex AI 提供了按量付费,相比GitHub Copilot每月10美元的订阅费,对于偶尔使用的开发者可能更灵活。

- 生态门槛:Gemma 4 原生支持 VS Code 插件(通过 Hugging Face 的 Transformers 或 Ollama),但与 JetBrains 系列 IDE 的集成尚需第三方工具。相比之下,Copilot 的IDE覆盖更广。

- 习惯门槛:许多开发者已经习惯了 Copilot 的“幽灵代码”建议模式。Gemma 4 的补全风格更偏向“按需生成”,需要一段时间适应。

一位参与早期测试的独立开发者分享:“Gemma 4 生成的代码结构很清晰,尤其擅长写单元测试和样板代码。但它不会像 Copilot 那样主动‘猜你想写’,而是等你输入几个字符后才补全。这种差异谈不上好坏,但需要重新适应。”

因此,从产品趋势与用户选择的视角看,Gemma 4 更像是一个“可定制的备选方案”,而非“一刀切的首选”。对于注重数据隐私、希望完全本地运行代码助手的团队或个人,它极具吸引力;而对于追求极致效率、不介意云端闭源服务的开发者,Copilot或通义灵码可能仍是更省心的选择。

三、潮·科技观察:Gemma 4 带来的三个潜在影响

即便Google 发布的开源大模型 Gemma4目前未必是所有人的首选,但它对整个AI编程生态的影响不容忽视。作为潮·科技栏目,我们更关注长期趋势:

影响一:推动开源模型的能力基线提升。此前,开源AI编程模型在HumanEval上超过65%的并不多见。Gemma 4 的加入,迫使其他开源模型(如StarCoder2、Qwen-Coder)加速迭代,最终受益的是开发者。

影响二:本地化编程助手将更普及。得益于Gemma 4 的高效量化技术,未来普通笔记本电脑甚至手机都能跑起不错的代码补全模型。这意味着在不联网、无云端API的场景下(如飞机、保密环境),AI编程依然可用。

影响三:商业与开源的分工更清晰。Google 通过开源轻量级模型,同时售卖云端高级版(更大上下文、更精细微调),实际上验证了“开源获客+商业变现”的路径。未来我们可能会看到更多AI公司效仿。

“搓一淘”视角:我们该如何选择?

作为搓一淘好物推荐站点,我们的立场一直是:帮用户找到最适合自己的“好物”,而非追求参数最强。对于AI编程工具,我们建议你问自己三个问题:

- 你的代码是否涉及商业机密或敏感数据?如果是,本地部署的Gemma 4 是更安全的选择。

- 你日常主要写什么语言?Python/Java/JS?Gemma 4 很好。Rust/Go?建议先试用再决定。

- 你愿意花多少时间配置环境?Ollama或LM Studio一键部署适合新手,但追求深度定制需要阅读官方文档。

综上所述,Google 发布的开源大模型 Gemma4确实为AI编程领域带来了一个有竞争力的新选择,但它能否成为“首选”高度依赖于用户的具体场景。对于追求数据自主、愿意接受新交互模式的开发者,它值得尝试;对于追求即插即用、无缝集成的用户,现有闭源方案可能更省心。而作为行业观察者,我们更欣喜地看到:开源与商业的良性竞争,正在让AI编程工具变得更好、更便宜、更普及。

你会把Gemma 4 加入你的AI工具箱吗?欢迎在搓一淘好物推荐的评论区分享你的实际体验。后续我们也将带来更详细的本地部署教程和插件测评,敬请关注潮·科技栏目的更新。

未经允许不得转载:搓一淘趣闻 » Gemma 4来了,AI编程的新选择?从用户视角看Google开源大模型|实用指南

北京范儿短视频大赛圆满收官:京味文化传承

北京范儿短视频大赛圆满收官:京味文化传承 全民共创短视频活动深度解析|京彩中国年创

全民共创短视频活动深度解析|京彩中国年创 智能语音控制空气炸锅深度体验:核心功能与

智能语音控制空气炸锅深度体验:核心功能与 中国科学家成功制备二维金属材料,实现材料

中国科学家成功制备二维金属材料,实现材料 AI驱动智能制造跨越式发展,从规模红利迈

AI驱动智能制造跨越式发展,从规模红利迈 智能家居选购攻略与未来打造指南,揭秘选购

智能家居选购攻略与未来打造指南,揭秘选购 未来热销产品盘点:智能化惊喜改变生活

未来热销产品盘点:智能化惊喜改变生活 咸味苏打饼干让人上瘾的简单秘密,竟藏在这

咸味苏打饼干让人上瘾的简单秘密,竟藏在这